【導(dǎo)讀】前文說過,根據(jù)有限的訓(xùn)練集,去適應(yīng)無限的測試集,當(dāng)然訓(xùn)練集容量越大效果就越好。但是,訓(xùn)練集如果很大,那么每次都根據(jù)全部數(shù)據(jù)執(zhí)行梯度下降計算量就太大了。此時,我們選擇每次只取全部訓(xùn)練集中的一小部分(究竟多少,一般根據(jù)內(nèi)存和計算量而定),執(zhí)行梯度下降,不斷的迭代,根據(jù)經(jīng)驗一樣可以快速地把梯度降下來。這就是隨機梯度下降。

三、梯度的下降(下)

前文的梯度下降法只能對f函數(shù)的w權(quán)重進行調(diào)整,而上文中我們說過實際是多層函數(shù)套在一起,例如f1(f2(x;w2);w1),那么怎么求對每一層函數(shù)輸入的導(dǎo)數(shù)呢?這也是所謂的反向傳播怎樣繼續(xù)反向傳遞下去呢?這就要提到鏈式法則。其實質(zhì)為,本來y對x的求導(dǎo),可以通過引入中間變量z來實現(xiàn),如下圖所示:

這樣,y對x的導(dǎo)數(shù)等價于y對z的導(dǎo)數(shù)乘以z對x的偏導(dǎo)。當(dāng)輸入為多維時則有下面的公式:

如此,我們可以得到每一層函數(shù)的導(dǎo)數(shù),這樣可以得到每層函數(shù)的w權(quán)重應(yīng)當(dāng)調(diào)整的步長,優(yōu)化權(quán)重參數(shù)。

由于函數(shù)的導(dǎo)數(shù)很多,例如resnet等網(wǎng)絡(luò)已經(jīng)達到100多層函數(shù),所以為區(qū)別傳統(tǒng)的機器學(xué)習(xí),我們稱其為深度學(xué)習(xí)。

深度學(xué)習(xí)只是受到神經(jīng)科學(xué)的啟發(fā),所以稱為神經(jīng)網(wǎng)絡(luò),但實質(zhì)上就是上面提到的多層函數(shù)前向運算得到分類值,訓(xùn)練時根據(jù)實際標簽分類取損失函數(shù)最小化后,根據(jù)隨機梯度下降法來優(yōu)化各層函數(shù)的權(quán)重參數(shù)。人臉識別也是這么一個流程。以上我們初步過完多層函數(shù)的參數(shù)調(diào)整,但函數(shù)本身應(yīng)當(dāng)如何設(shè)計呢?

四、基于CNN卷積神經(jīng)網(wǎng)絡(luò)進行人臉識別

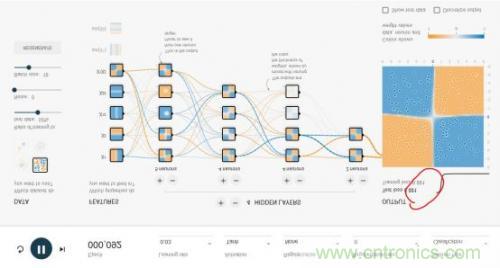

我們先從全連接網(wǎng)絡(luò)談起。Google的TensorFlow游樂場里可以直觀的體驗全連接神經(jīng)網(wǎng)絡(luò)的威力,這是游樂場的網(wǎng)址:http://playground.tensorflow.org/,瀏覽器里就可以做神經(jīng)網(wǎng)絡(luò)訓(xùn)練,且過程與結(jié)果可視化。如下圖所示:

這個神經(jīng)網(wǎng)絡(luò)游樂場共有1000個訓(xùn)練點和1000個測試點,用于對4種不同圖案劃分出藍色點與黃色點。DATA處可選擇4種不同圖案。

整個網(wǎng)絡(luò)的輸入層是FEATURES(待解決問題的特征),例如x1和x2表示垂直或者水平切分來劃分藍色與黃色點,這是最容易理解的2種劃分點的方法。其余5種其實不太容易想到,這也是傳統(tǒng)的專家系統(tǒng)才需要的,實際上,這個游樂場就是為了演示,1、好的神經(jīng)網(wǎng)絡(luò)只用最基本的x1,x2這樣的輸入層FEATURES就可以完美的實現(xiàn);2、即使有很多種輸入特征,我們其實并不清楚誰的權(quán)重最高,但好的神經(jīng)網(wǎng)絡(luò)會解決掉這個問題。

隱層(HIDDEN LAYERS)可以隨意設(shè)置層數(shù),每個隱層可以設(shè)置神經(jīng)元數(shù)。實際上神經(jīng)網(wǎng)絡(luò)并不是在計算力足夠的情況下,層數(shù)越多越好或者每層神經(jīng)元越多越好。好的神經(jīng)網(wǎng)絡(luò)架構(gòu)模型是很難找到的。本文后面我們會重點講幾個CNN經(jīng)典網(wǎng)絡(luò)模型。然而,在這個例子中,多一些隱層和神經(jīng)元可以更好地劃分。

epoch是訓(xùn)練的輪數(shù)。紅色框出的loss值是衡量訓(xùn)練結(jié)果的最重要指標,如果loss值一直是在下降,比如可以低到0.01這樣,就說明這個網(wǎng)絡(luò)訓(xùn)練的結(jié)果好。loss也可能下降一會又突然上升,這就是不好的網(wǎng)絡(luò),大家可以嘗試下。learning rate初始都會設(shè)得高些,訓(xùn)練到后面都會調(diào)低些。Activation是激勵函數(shù),目前CNN都在使用Relu函數(shù)。

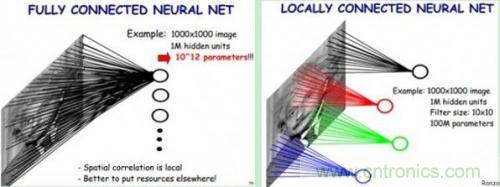

了解了神經(jīng)網(wǎng)絡(luò)后,現(xiàn)在我們回到人臉識別中來。每一層神經(jīng)元就是一個f函數(shù),上面的四層網(wǎng)絡(luò)就是f1(f2(f3(f4(x))))。然而,就像上文所說,照片的像素太多了,全連接網(wǎng)絡(luò)中任意兩層之間每兩個神經(jīng)元都需要有一次計算。特別之前提到的,復(fù)雜的分類依賴于許多層函數(shù)共同運算才能達到目的。當(dāng)前的許多網(wǎng)絡(luò)都是多達100層以上,如果每層都有3*100*100個神經(jīng)元,可想而知計算量有多大!于是CNN卷積神經(jīng)網(wǎng)絡(luò)應(yīng)運而生,它可以在大幅降低運算量的同時保留全連接網(wǎng)絡(luò)的威力。

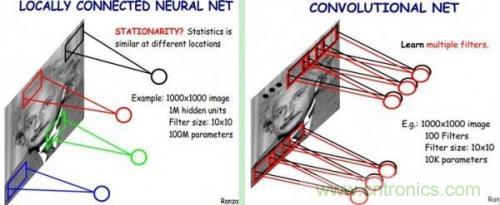

CNN認為可以只對整張圖片的一個矩形窗口做全連接運算(可稱為卷積核),滑動這個窗口以相同的權(quán)重參數(shù)w遍歷整張圖片后,可以得到下一層的輸入,如下圖所示:

CNN中認為同一層中的權(quán)重參數(shù)可以共享,因為同一張圖片的各個不同區(qū)域具有一定的相似性。這樣原本的全連接計算量過大問題就解決了,如下圖所示:

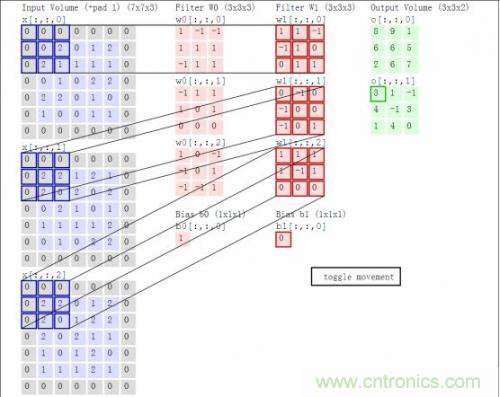

結(jié)合著之前的函數(shù)前向運算與矩陣,我們以一個動態(tài)圖片直觀的看一下前向運算過程:

這里卷積核大小與移動的步長stride、輸出深度決定了下一層網(wǎng)絡(luò)的大小。同時,核大小與stride步長在導(dǎo)致上一層矩陣不夠大時,需要用padding來補0(如上圖灰色的0)。以上就叫做卷積運算,這樣的一層神經(jīng)元稱為卷積層。上圖中W0和W1表示深度為2。

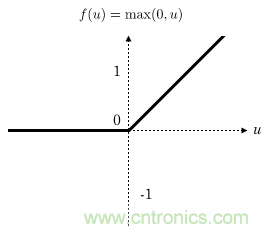

CNN卷積網(wǎng)絡(luò)通常在每一層卷積層后加一個激勵層,激勵層就是一個函數(shù),它把卷積層輸出的數(shù)值以非線性的方式轉(zhuǎn)換為另一個值,在保持大小關(guān)系的同時約束住值范圍,使得整個網(wǎng)絡(luò)能夠訓(xùn)練下去。在人臉識別中,通常都使用Relu函數(shù)作為激勵層,Relu函數(shù)就是max(0,x),如下所示:

可見 Relu的計算量其實非常??!

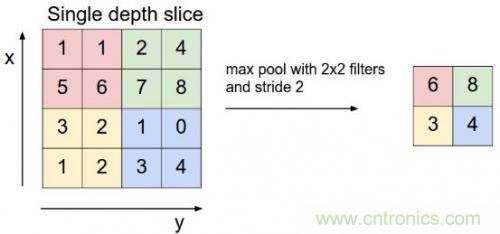

CNN中還有一個池化層,當(dāng)某一層輸出的數(shù)據(jù)量過大時,通過池化層可以對數(shù)據(jù)降維,在保持住特征的情況下減少數(shù)據(jù)量,例如下面的4*4矩陣通過取最大值降維到2*2矩陣:

上圖中通過對每個顏色塊篩選出最大數(shù)字進行池化,以減小計算數(shù)據(jù)量。

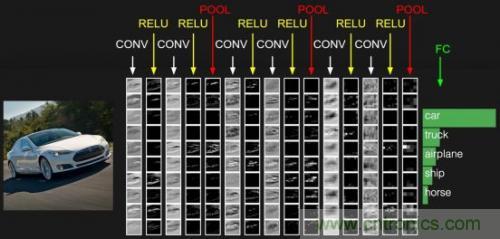

通常網(wǎng)絡(luò)的最后一層為全連接層,這樣一般的CNN網(wǎng)絡(luò)結(jié)構(gòu)如下所示:

CONV就是卷積層,每個CONV后會攜帶RELU層。這只是一個示意圖,實際的網(wǎng)絡(luò)要復(fù)雜許多。目前開源的Google FaceNet是采用resnet v1網(wǎng)絡(luò)進行人臉識別的,關(guān)于resnet網(wǎng)絡(luò)請參考論文https://arxiv.org/abs/1602.07261,其完整的網(wǎng)絡(luò)較為復(fù)雜,這里不再列出,也可以查看基于TensorFlow實現(xiàn)的Python代碼https://github.com/davidsandberg/facenet/blob/master/src/models/inception_resnet_v1.py,注意slim.conv2d含有Relu激勵層。

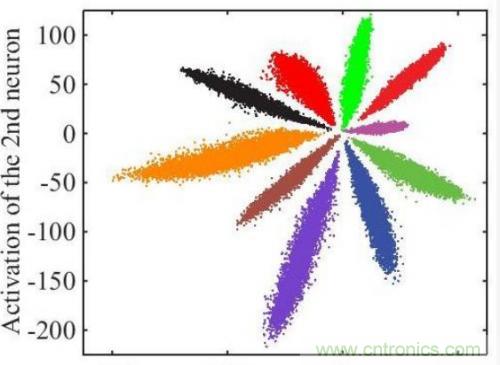

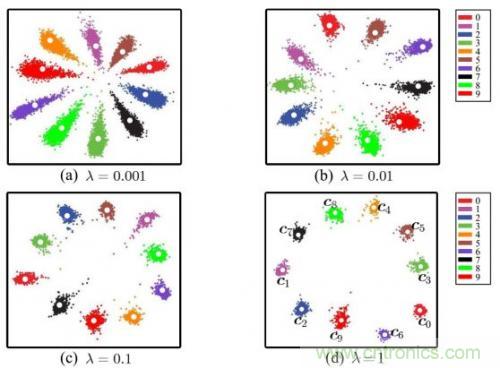

以上只是通用的CNN網(wǎng)絡(luò),由于人臉識別應(yīng)用中不是直接分類,而是有一個注冊階段,需要把照片的特征值取出來。如果直接拿softmax分類前的數(shù)據(jù)作為特征值效果很不好,例如下圖是直接將全連接層的輸出轉(zhuǎn)化為二維向量,在二維平面上通過顏色表示分類的可視化表示:

可見效果并不好,中間的樣本距離太近了。通過centor loss方法處理后,可以把特征值間的距離擴大,如下圖所示:

這樣取出的特征值效果就會好很多。

實際訓(xùn)練resnet v1網(wǎng)絡(luò)時,首先需要關(guān)注訓(xùn)練集照片的質(zhì)量,且要把不同尺寸的人臉照片resize到resnet1網(wǎng)絡(luò)首層接收的尺寸大小。另外除了上面提到的學(xué)習(xí)率和隨機梯度下降中每一批batchsize圖片的數(shù)量外,還需要正確的設(shè)置epochsize,因為每一輪epoch應(yīng)當(dāng)完整的遍歷完訓(xùn)練集,而batchsize受限于硬件條件一般不變,但訓(xùn)練集可能一直在變大,這樣應(yīng)保持epochsize*batchsize接近全部訓(xùn)練集。訓(xùn)練過程中需要密切關(guān)注loss值是否在收斂,可適當(dāng)調(diào)節(jié)學(xué)習(xí)率。

最后說一句,目前人臉識別效果的評價唯一通行的標準是LFW(即Labeled Faces in the Wild),它包含大約6000個不同的人的12000張照片,許多算法都依據(jù)它來評價準確率。但它有兩個問題,一是數(shù)據(jù)集不夠大,二是數(shù)據(jù)集場景往往與真實應(yīng)用場景并不匹配。所以如果某個算法稱其在LFW上的準確率達到多么的高,并不能反應(yīng)其真實可用性。